Si trabajas en SEO, Screaming Frog es probablemente la herramienta que más vas a usar en tu día a día. Es un crawler de escritorio que analiza tu sitio web como lo haría Google: recorre cada URL, revisa los títulos, las meta descriptions, los encabezados, los enlaces, las imágenes y decenas de factores técnicos que afectan tu posicionamiento.

En este tutorial te voy a enseñar cómo usar Screaming Frog desde cero, con capturas reales de un rastreo que hice a mi propio sitio (juliandurango.com). Si todavía no tienes claro cómo organizar tu contenido, empieza por crear un mapa temático SEO. No vas a encontrar teoría genérica: cada sección incluye qué buscar, cómo interpretarlo y qué acción tomar.

Lo que vas a aprender:

- Cómo instalar, configurar y ejecutar tu primer rastreo

- Cómo interpretar cada pestaña de análisis

- Cómo detectar errores técnicos, de contenido y de enlazado

- Cómo configurar el crawler para sitios grandes (+10K URLs)

- Workflow profesional: de la auditoría a la hoja de ruta SEO

¿Qué es Screaming Frog y para qué sirve?

Screaming Frog SEO Spider es un programa de escritorio (Windows, Mac y Linux) que rastrea sitios web imitando el comportamiento de un bot de búsqueda. A diferencia de herramientas en la nube como Ahrefs o Semrush, Screaming Frog se instala en tu computador y ejecuta el rastreo desde ahí, lo que te da control total sobre la velocidad, profundidad y configuración.

La versión gratuita permite rastrear hasta 500 URLs, suficiente para sitios de PYMEs y negocios medianos. La licencia de pago (£259/año) elimina ese límite y desbloquea funciones avanzadas como extracción personalizada, integraciones con Google Analytics y Search Console, y rastreo programado.

¿Para qué lo uso yo como consultor SEO? Para absolutamente todo el SEO técnico: detectar errores de rastreo, analizar la arquitectura del sitio, auditar el contenido on-page, revisar el enlazado interno y el flujo de link juice, validar migraciones y encontrar oportunidades de optimización que las herramientas online no detectan.

Puedes descargarlo gratis desde screamingfrog.co.uk. Si buscas una referencia rápida, tengo una guía básica de Screaming Frog en PDF. La instalación es directa: descarga el archivo, ejecuta el instalador y listo.

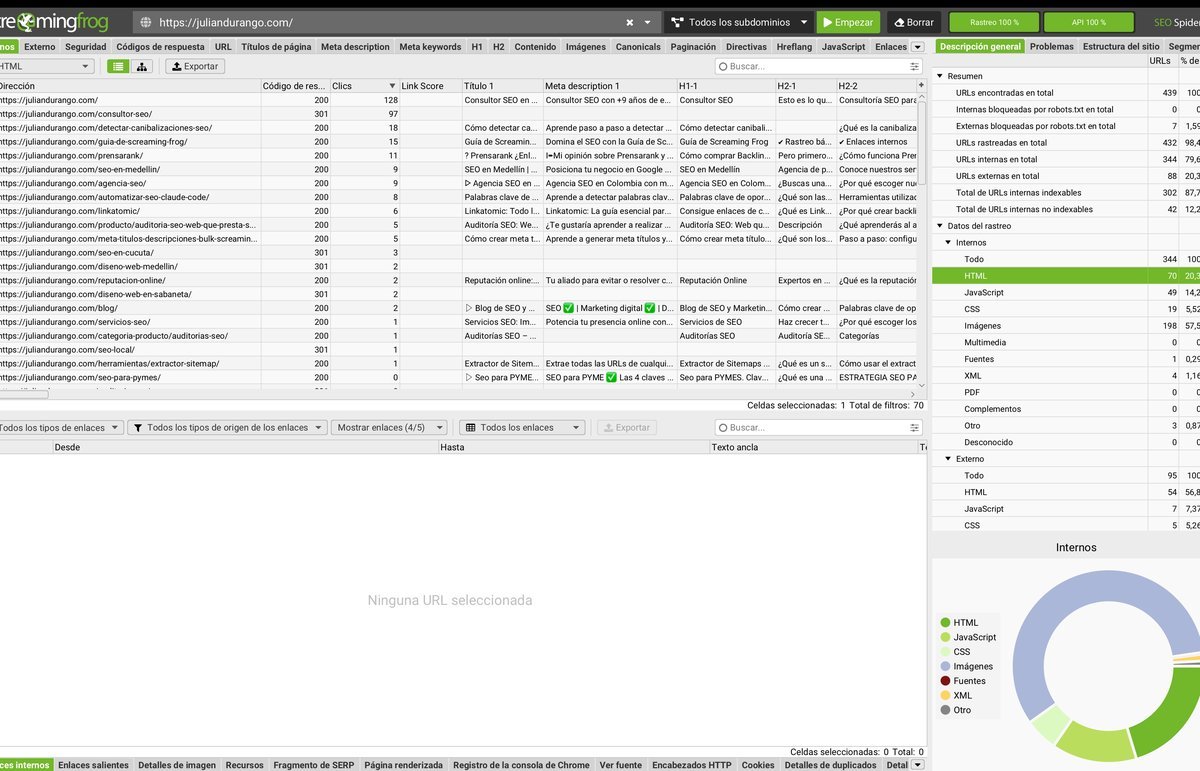

Conoce la interfaz de Screaming Frog

Antes de lanzar tu primer rastreo, necesitas entender las 5 zonas principales de la interfaz:

- Barra de URL — Arriba del todo. Aquí ingresas la dirección del sitio que quieres rastrear y presionas Empezar

- Pestañas de análisis — La fila horizontal debajo de la barra. Cada pestaña (Internos, Externos, Códigos de respuesta, Títulos, Meta descriptions, H1, H2, Imágenes, Canonicals, Directivas, Hreflang) agrupa un tipo de dato

- Tabla de resultados — El área central que ocupa la mayor parte de la pantalla. Lista cada URL con todas sus métricas en columnas

- Panel de resumen (derecha) — Descripción general con totales, datos del rastreo, y estadísticas por tipo de contenido

- Panel inferior — Detalle de la URL seleccionada: enlaces internos, enlaces salientes, detalles de imagen, fragmento de SERP, vista de código fuente

Cómo configurar Screaming Frog antes de rastrear

La configuración por defecto de Screaming Frog funciona bien para la mayoría de sitios, pero si quieres resultados óptimos necesitas ajustar algunos parámetros antes de iniciar el rastreo. Todo se encuentra en el menú Configuración.

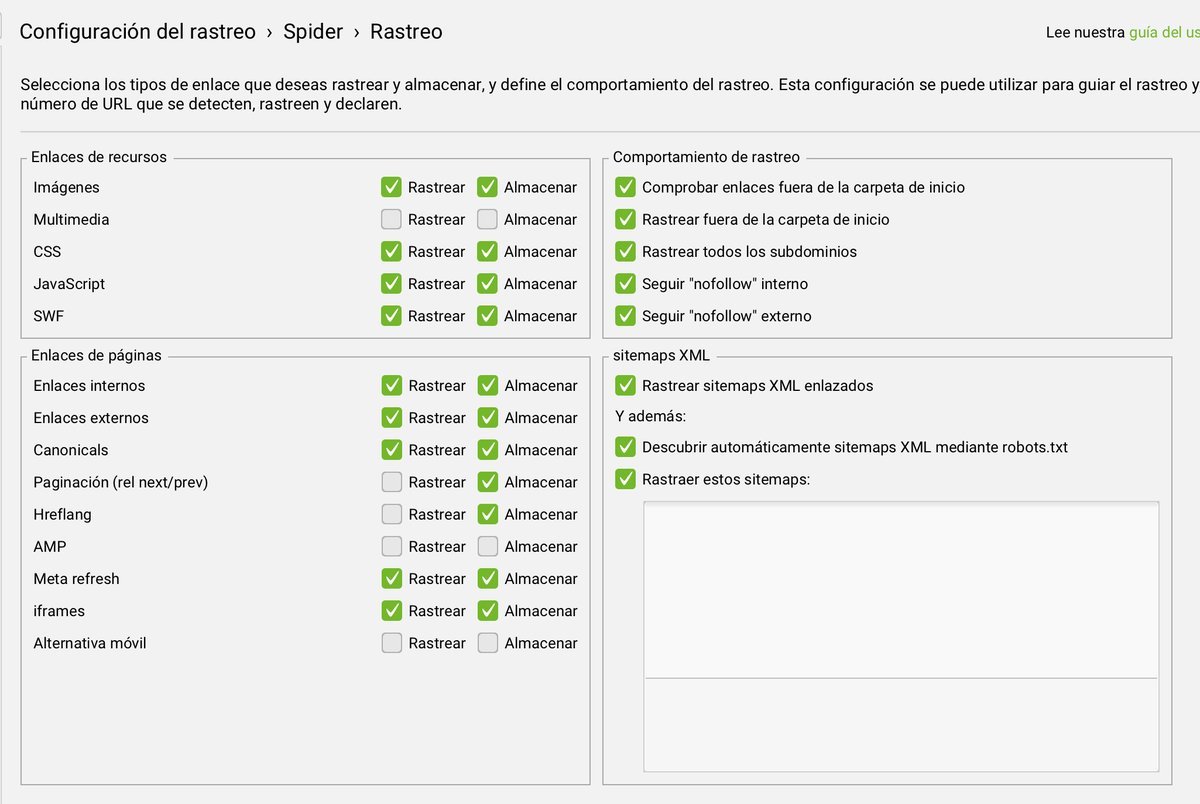

Configuración del Spider

En Configuración → Spider defines qué elementos debe rastrear. Mi recomendación para una auditoría estándar:

- Rastrear enlaces internos: Activado (fundamental)

- Rastrear enlaces externos: Activado (para detectar enlaces rotos salientes)

- Rastrear imágenes: Activado (para auditar alt text y tamaño)

- Rastrear CSS/JS: Activado si necesitas auditar renderizado

- Rastrear hreflang: Activado solo para sitios multiidioma

Si tu sitio usa JavaScript pesado (React, Angular, Vue), activa el renderizado JavaScript en la pestaña “Rendering” dentro de Spider. Esto hace que el rastreo sea más lento pero mucho más preciso.

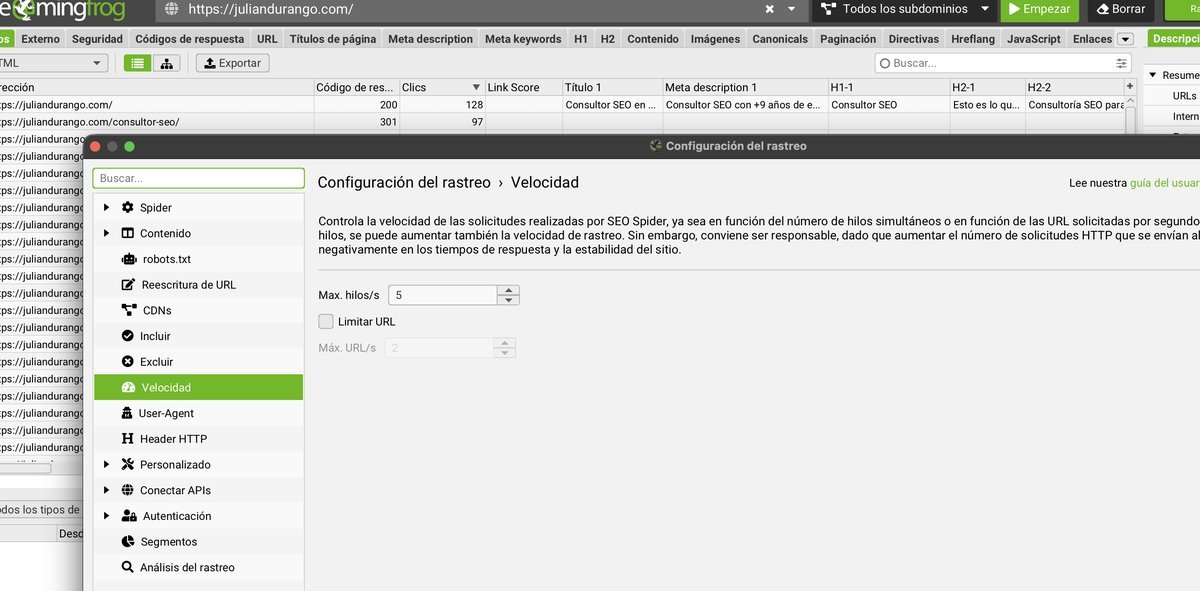

Velocidad de rastreo

En Configuración → Velocidad controlas cuántas solicitudes simultáneas hace el crawler. Mis recomendaciones:

Sitio propio o con permiso

5-10 hilos simultáneos. Sin límite de URLs.

Sitio de un cliente

2-5 hilos. Activa “Limitar URL” si tiene +50K páginas.

Servidor compartido o débil

1-2 hilos. Reduce para no tumbar el sitio.

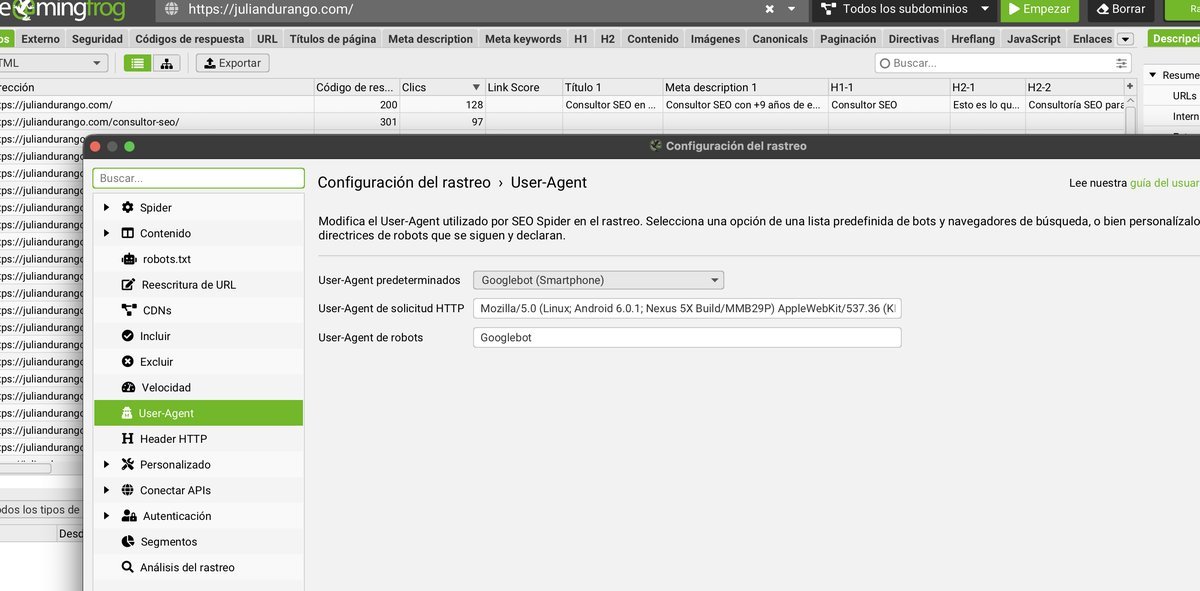

User-Agent

En Configuración → User-Agent eliges cómo se identifica el crawler. Esto es importante porque algunos sitios muestran contenido diferente según el bot que los visita.

- Googlebot — Para ver exactamente lo que ve Google (opción recomendada por defecto)

- Googlebot Mobile — Para auditar la versión móvil (critical con Mobile-First Indexing)

- Chrome — Para ver lo que ve un usuario real

- Custom — Si necesitas simular un bot específico o evadir bloqueos

Pro tip: Haz un rastreo con Googlebot Desktop y otro con Googlebot Mobile. Compara los resultados. Si hay diferencias significativas, tienes un problema de paridad mobile-desktop que puede afectar tu indexación.

Cómo ejecutar tu primer rastreo

Con la configuración lista, el proceso es simple:

- Ingresa la URL de tu sitio en la barra superior (con https://)

- Selecciona el modo de rastreo: “Todos los subdominios” para un análisis completo, o “Este subdominio” para solo www

- Haz clic en Empezar (o presiona Enter)

- Espera a que termine. Screaming Frog mostrará el progreso en la barra inferior

El tiempo depende del tamaño del sitio y la velocidad configurada. Un sitio de 500 páginas tarda entre 2 y 5 minutos. Uno de 50.000 puede tardar horas.

Alternativa: rastreo de lista de URLs. Si solo necesitas analizar URLs específicas, ve a Modo → Lista y pega o importa las URLs que quieras auditar. Es útil para verificar migraciones o auditar landing pages concretas.

Cómo interpretar cada pestaña de Screaming Frog

Aquí es donde está el valor real. Cada pestaña te muestra un aspecto diferente del SEO de tu sitio. Voy a explicarte las más importantes con ejemplos reales del rastreo de mi web.

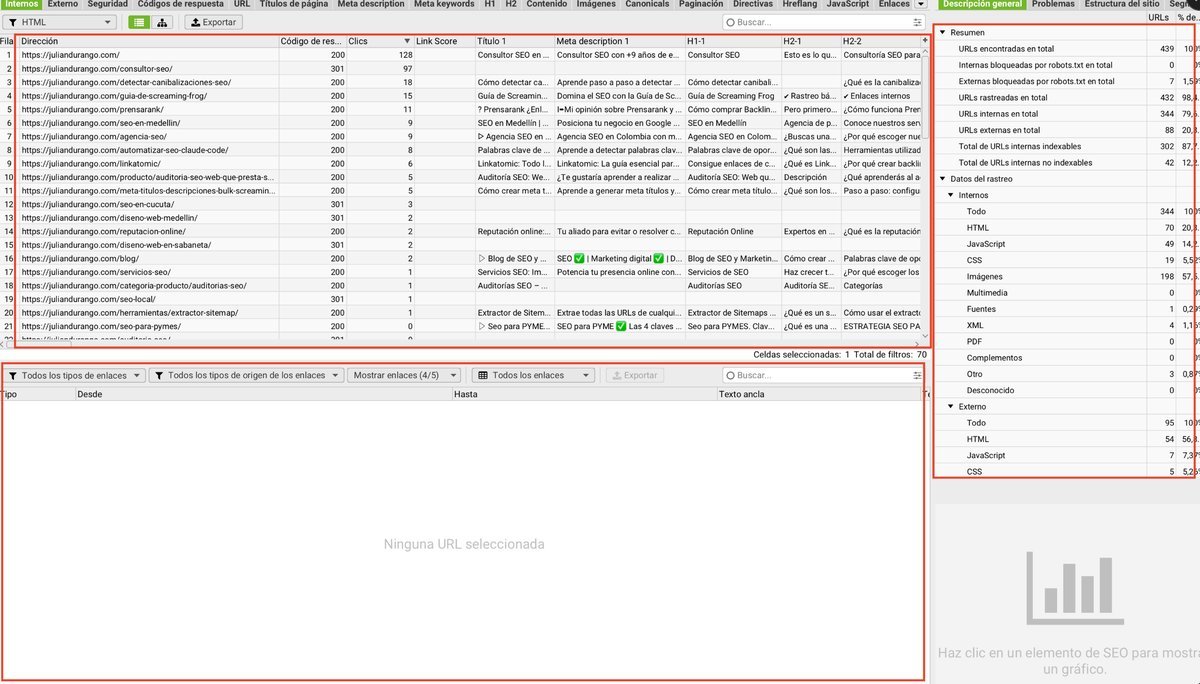

Pestaña Internos: el mapa completo de tu sitio

La pestaña Internos muestra todas las URLs que pertenecen a tu dominio. Es la vista principal y la que más vas a usar. Para cada URL puedes ver:

- Código de respuesta — 200 (OK), 301 (redirección), 404 (no encontrada)

- Título, H1 y Meta Description — Contenido on-page de un vistazo

- Clics — Profundidad de rastreo (a cuántos clics del home)

- Tipo de contenido — HTML, imagen, CSS, JavaScript, PDF

Qué buscar: Filtra por código de respuesta distinto de 200. Cualquier URL que no devuelva 200 necesita revisión. También filtra por “Indexable” para ver solo las páginas que Google puede indexar.

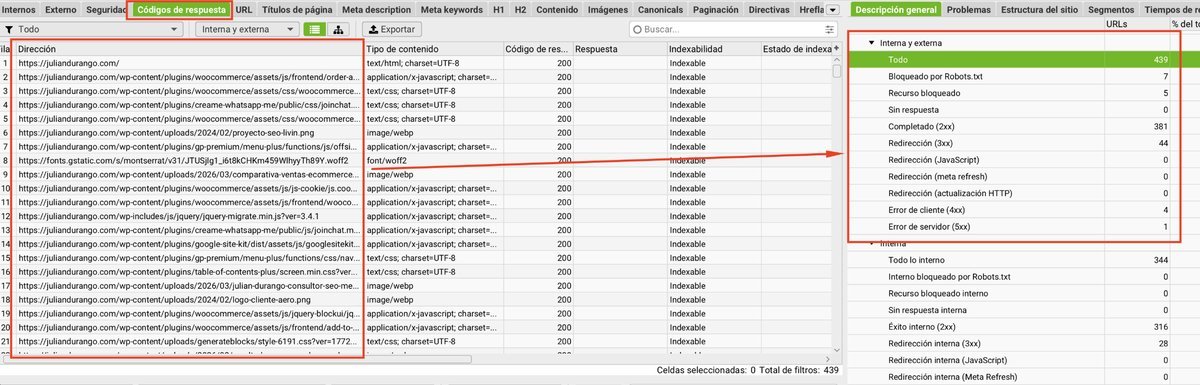

Códigos de respuesta: detecta redirecciones y errores

La pestaña Códigos de respuesta agrupa las URLs por su código HTTP. Es una de las más importantes para el SEO técnico:

200 OK

Todo bien. La página carga correctamente.

301 Redirect

Redirección permanente. Revisa que no haya cadenas.

404 Not Found

Página no encontrada. Redirige o elimina los enlaces.

500 Server Error

Error del servidor. Prioridad máxima de corrección.

Acción: Exporta todas las URLs con código 3xx y 4xx. Para las 301, verifica que cada redirección apunte directamente al destino final (sin cadenas). Para las 404, identifica qué páginas las enlazan y corrige o redirige. Las cadenas de redirección (301 → 301 → 200) son uno de los problemas técnicos más comunes y más fáciles de resolver.

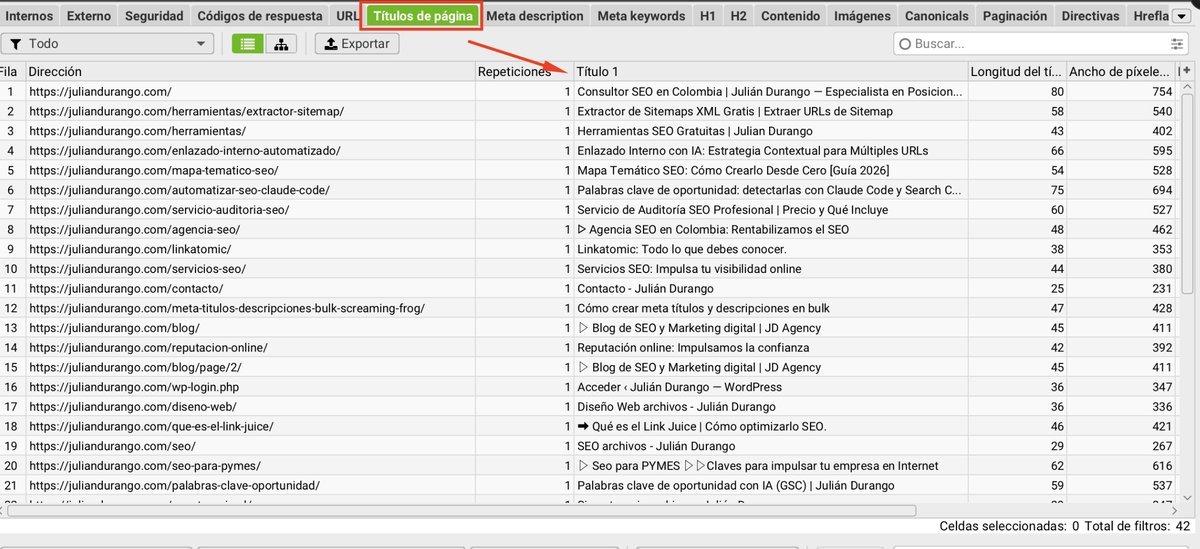

Títulos de página (Title Tags)

La pestaña Títulos de página te permite auditar todos los title tags de tu sitio. El filtro desplegable te muestra:

- Duplicados: Dos o más páginas con el mismo título (canibalización potencial)

- Vacíos: Páginas sin title tag (error grave)

- Más de 60 caracteres: Títulos que se truncarán en Google

- Menos de 30 caracteres: Títulos demasiado cortos, pierdes oportunidad de keywords

Acción: Cada página indexable debería tener un título único que incluya su keyword principal, tenga entre 50 y 60 caracteres, y sea descriptivo para el usuario.

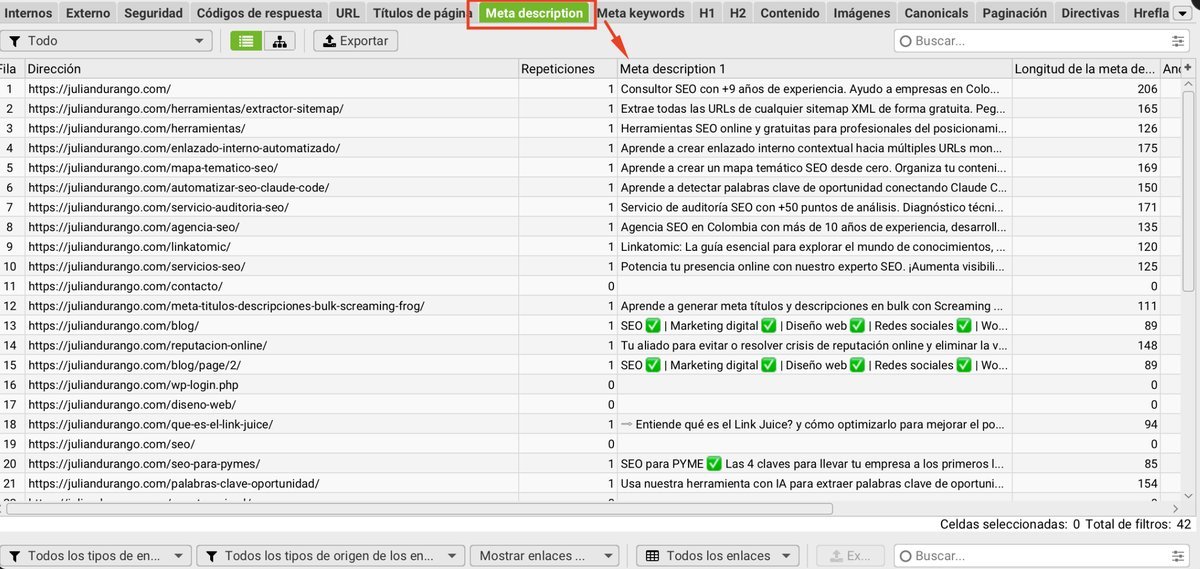

Meta Descriptions

Similar a los títulos, la pestaña Meta description te muestra el estado de todas las meta descriptions del sitio. Los filtros detectan:

- Vacías: Google generará un snippet automático (no siempre favorable)

- Duplicadas: Señal de contenido repetitivo o templates mal configurados

- Más de 160 caracteres: Se truncarán en los resultados

Acción: Prioriza escribir meta descriptions únicas para las páginas que más tráfico reciben o que tienen mayor potencial de posicionamiento. Incluye un call-to-action y tu keyword de forma natural.

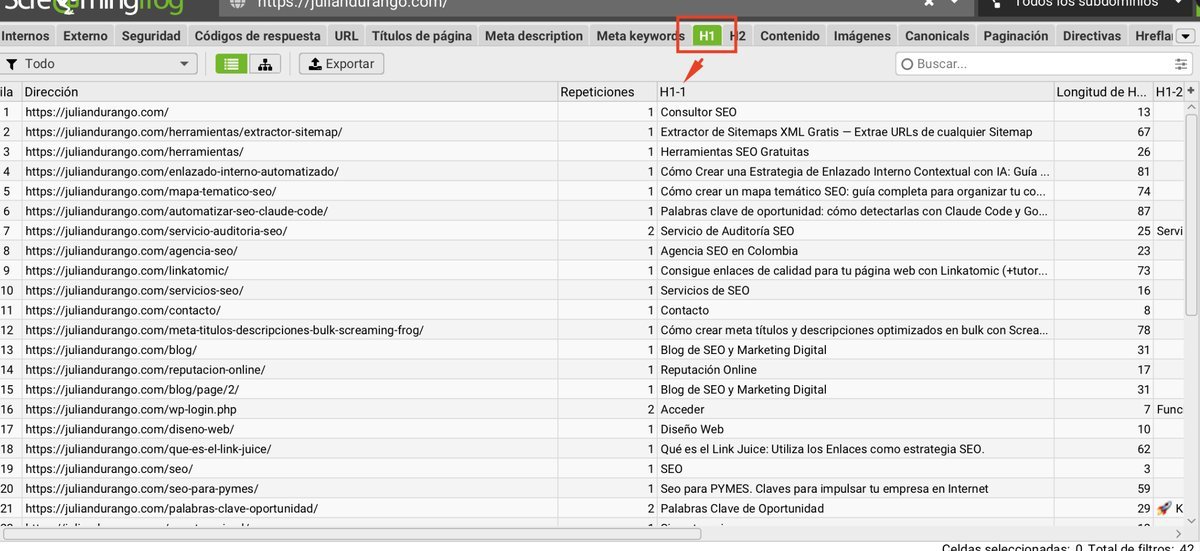

Encabezados H1 y H2

Las pestañas H1 y H2 te permiten auditar la estructura de encabezados. Errores comunes que encontrarás:

- Sin H1: Cada página indexable necesita exactamente un H1

- Múltiples H1: Confunde a Google sobre el tema principal de la página

- H1 duplicados: Mismo problema que los títulos duplicados

- H1 ≠ Title: Deberían ser similares pero no idénticos (oportunidad para variaciones de keyword)

Pro tip: Exporta los H1 y H2 a Excel, ordénalos alfabéticamente y busca patrones repetitivos. Es la forma más rápida de detectar canibalización a nivel de headings.

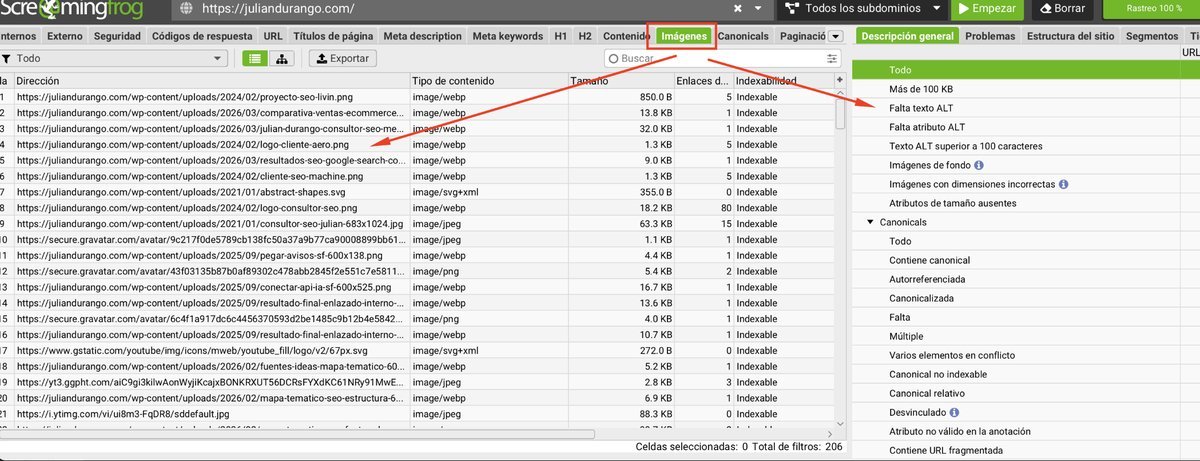

Imágenes y atributos alt

La pestaña Imágenes muestra cada imagen encontrada en el rastreo con su tamaño, formato y texto alternativo. Lo que debes revisar:

- Imágenes sin alt text: Pierdes oportunidad de posicionar en Google Images

- Imágenes >200KB: Afectan la velocidad de carga y los Core Web Vitals

- Formato no optimizado: Convierte PNG a WebP o AVIF cuando sea posible

Acción: Filtra por “Missing Alt Text” y genera una lista de todas las imágenes que necesitan texto alternativo. Para las imágenes pesadas, usa herramientas como ShortPixel o Imagify para comprimirlas sin perder calidad visible.

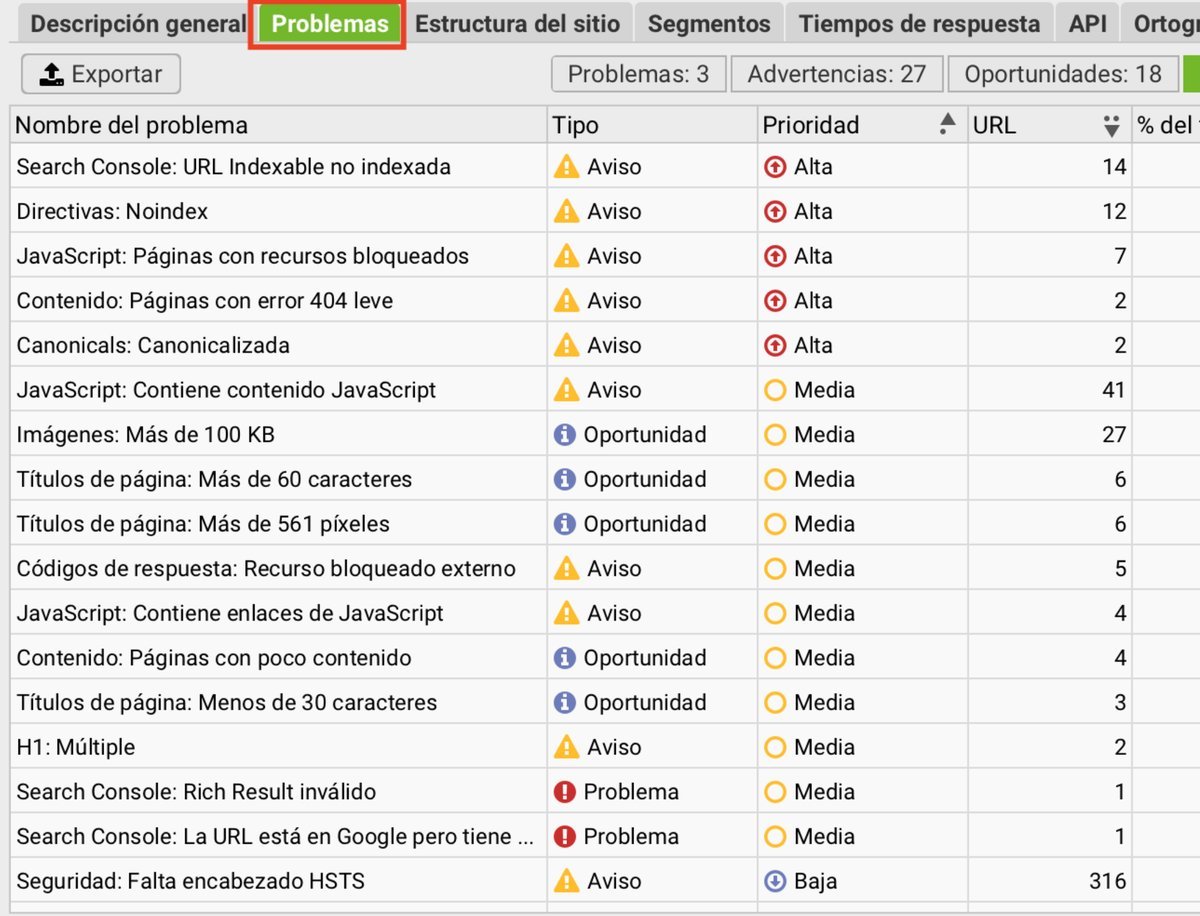

El Panel de Problemas: tu checklist de errores

El panel Problemas (en la parte derecha) es una de las funciones más valiosas de Screaming Frog. Te genera automáticamente una lista de todos los errores y advertencias encontrados, clasificados por prioridad:

- Errores (rojo): Problemas críticos que afectan la indexación: 404, errores de servidor, páginas sin title

- Advertencias (naranja): Problemas que afectan el rendimiento: títulos duplicados, meta descriptions largas, redirecciones

- Oportunidades (azul): Mejoras posibles: contenido thin, páginas profundas, enlaces internos sin anchor text

Workflow: Yo siempre empiezo por aquí. Exporto la lista de problemas a Excel, la ordeno por tipo y cantidad de URLs afectadas, y creo el backlog de la auditoría directamente desde esta vista. Es el punto de partida perfecto para cualquier auditoría SEO profesional.

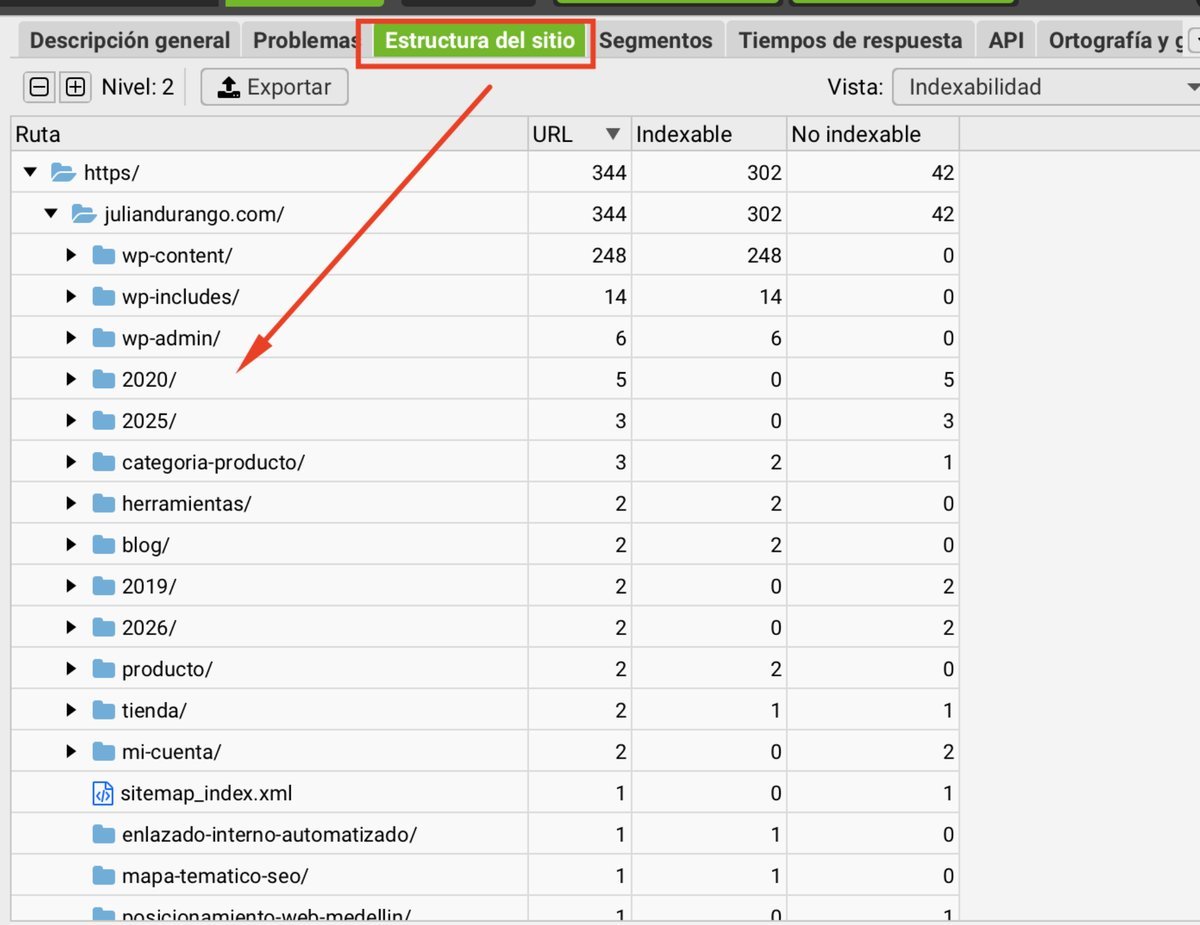

Estructura del sitio: visualiza tu arquitectura

La pestaña Estructura del sitio te muestra cómo están organizadas las URLs por directorio y nivel de profundidad. Esto te permite:

- Ver cuántos clics separan cada página del home (la profundidad de rastreo)

- Detectar páginas huérfanas que no reciben enlaces internos

- Identificar secciones con demasiadas páginas en niveles profundos

Regla general: Ninguna página importante debería estar a más de 3 clics del home. Si tienes páginas a 5 o 6 niveles de profundidad, necesitas mejorar tu enlazado interno para acercarlas.

Funciones avanzadas que pocos usan

Extracción personalizada (Custom Extraction)

En Configuración → Personalizado → Extracción puedes definir selectores CSS o XPath para extraer cualquier dato de las páginas: precios, SKUs, autores, fechas de publicación, datos estructurados, o cualquier elemento del HTML.

Ejemplo práctico: para auditar Schema markup, puedes extraer el contenido de <script type="application/ld+json"> con XPath y verificar que todas las páginas tengan datos estructurados correctos.

Integración con APIs externas

Screaming Frog permite conectar APIs de Google Search Console, Google Analytics 4, PageSpeed Insights e incluso modelos de Inteligencia Artificial (puedes incluso automatizar tareas SEO con IA desde la terminal). Más abajo en este tutorial encontrarás el paso a paso completo para conectar cada una, incluyendo la nueva integración con IA que permite analizar contenido automáticamente con GPT-4, Gemini o Claude.

Rastreo programado (Scheduling)

Puedes programar rastreos automáticos que se ejecuten diariamente, semanalmente o mensualmente. El crawler guarda los resultados y puedes comparar rastreos para detectar cambios en el sitio: nuevas URLs, páginas que desaparecieron, títulos modificados o nuevos errores.

Es especialmente útil para sitios grandes o e-commerce donde el inventario cambia constantemente. Configura un rastreo semanal y revisa las diferencias cada lunes.

Generación de Sitemaps XML

Screaming Frog puede generar sitemaps XML directamente desde el menú Sitemaps. Útil si necesitas crear un sitemap limpio que incluya solo las URLs indexables con código 200, excluyendo automáticamente las redirecciones, los 404 y las páginas noindex.

Cómo configurar Screaming Frog para sitios grandes (+10K URLs)

Con sitios pequeños (menos de 500 URLs) la configuración por defecto funciona sin problemas. Pero cuando trabajas con e-commerce, portales de noticias o sitios con más de 10.000 URLs, necesitas ajustar Screaming Frog para que no se quede sin memoria, no tumbe el servidor y termine el rastreo en un tiempo razonable.

Aumentar la memoria RAM asignada

Por defecto Screaming Frog usa entre 2-4 GB de RAM. Para sitios grandes necesitas más:

- Ve a Archivo → Configuración de la aplicación → Memoria

- Aumenta la asignación a 8-12 GB (o más si tu máquina lo permite)

- Reinicia Screaming Frog para que aplique el cambio

Si tu equipo no tiene suficiente RAM, activa el modo de almacenamiento en base de datos desde Configuración → Spider → Almacenamiento → Base de datos. En lugar de mantener todo en memoria, guarda los datos en disco. Es más lento pero permite rastrear sitios de cientos de miles de URLs sin problemas.

Reducir la velocidad de rastreo

Un rastreo agresivo a un sitio grande puede sobrecargar el servidor y provocar errores 503 o bloqueos. Ve a Configuración → Spider → Velocidad y reduce las solicitudes simultáneas a 1-2 hilos con un intervalo de 500-1000ms entre peticiones. Sí, el rastreo tardará más, pero obtendrás datos limpios sin saturar la infraestructura del cliente.

Desactivar lo que no necesitas

Cada recurso que Screaming Frog rastrea consume memoria y tiempo. Para sitios grandes, desactiva lo innecesario:

- Imágenes, CSS, JavaScript y SWF — Desmarca “Rastrear” en Spider → Rastreo si no los necesitas para la auditoría

- Enlaces externos — Si solo te interesa el SEO on-site, desactiva el rastreo de enlaces externos

- Renderizado JavaScript — Solo actívalo si el sitio depende de JS para cargar contenido. El renderizado multiplica el tiempo de rastreo

Usar Incluir/Excluir para segmentar

No siempre necesitas rastrear todo el sitio. Usa las reglas de inclusión y exclusión para segmentar:

- Incluir (Configuración → Incluir) — Limita el rastreo a una sección específica, ej:

https://sitio.com/blog/ - Excluir (Configuración → Excluir) — Bloquea secciones que no aportan, ej:

/tag/,/author/,/page/, URLs con parámetros de filtros

Esto reduce drásticamente el número de URLs y el tiempo de rastreo, y te permite hacer auditorías por secciones: primero el blog, luego las fichas de producto, luego las categorías.

Mi recomendación para +50K URLs: Haz primero un rastreo ligero (sin JS, sin externos, sin recursos) para tener el mapa general del sitio. Después haz rastreos segmentados por sección con la configuración completa activada. Es más eficiente y obtienes datos más manejables para priorizar acciones.

Mi workflow de auditoría con Screaming Frog

Después de años haciendo auditorías SEO, este es el proceso que sigo cada vez que abro Screaming Frog para un nuevo proyecto:

Configurar

Spider, velocidad, User-Agent según el proyecto

Rastrear

Ejecutar crawl completo y esperar a que termine

Problemas

Revisar panel de problemas y exportar errores

Priorizar

Ordenar hallazgos por impacto y crear backlog

Paso 1: Configuro el Spider según el tipo de sitio. Para e-commerce activo el rastreo de parámetros de URL. Para sitios con JavaScript pesado, activo el renderizado. Ajusto la velocidad según el servidor.

Paso 2: Lanzo el crawl y mientras espero, reviso el sitio manualmente para tener contexto. Navego como usuario, pruebo en móvil, miro el código fuente de las páginas clave.

Paso 3: Cuando termina, voy directo al panel de Problemas. Exporto todo a Excel. Luego reviso las pestañas clave: Códigos de respuesta (busco 3xx y 4xx), Títulos (duplicados y vacíos), Meta descriptions, H1 (duplicados y múltiples), Imágenes (sin alt), Canonicals (incorrectas).

Paso 4: Con toda la información, creo un backlog priorizado (en mi curso de auditoría SEO enseño este proceso en detalle): primero los errores que bloquean la indexación (5xx, noindex accidental), luego las redirecciones y 404, después las mejoras de on-page (títulos, meta, H1), y finalmente las optimizaciones de velocidad y UX.

Cómo conectar las APIs en Screaming Frog (GSC, GA4, IA)

Una de las funciones más potentes de Screaming Frog (versión de pago) es la posibilidad de conectar APIs externas para enriquecer los datos del rastreo. En lugar de cruzar datos manualmente en Excel, obtienes toda la información integrada en una sola vista.

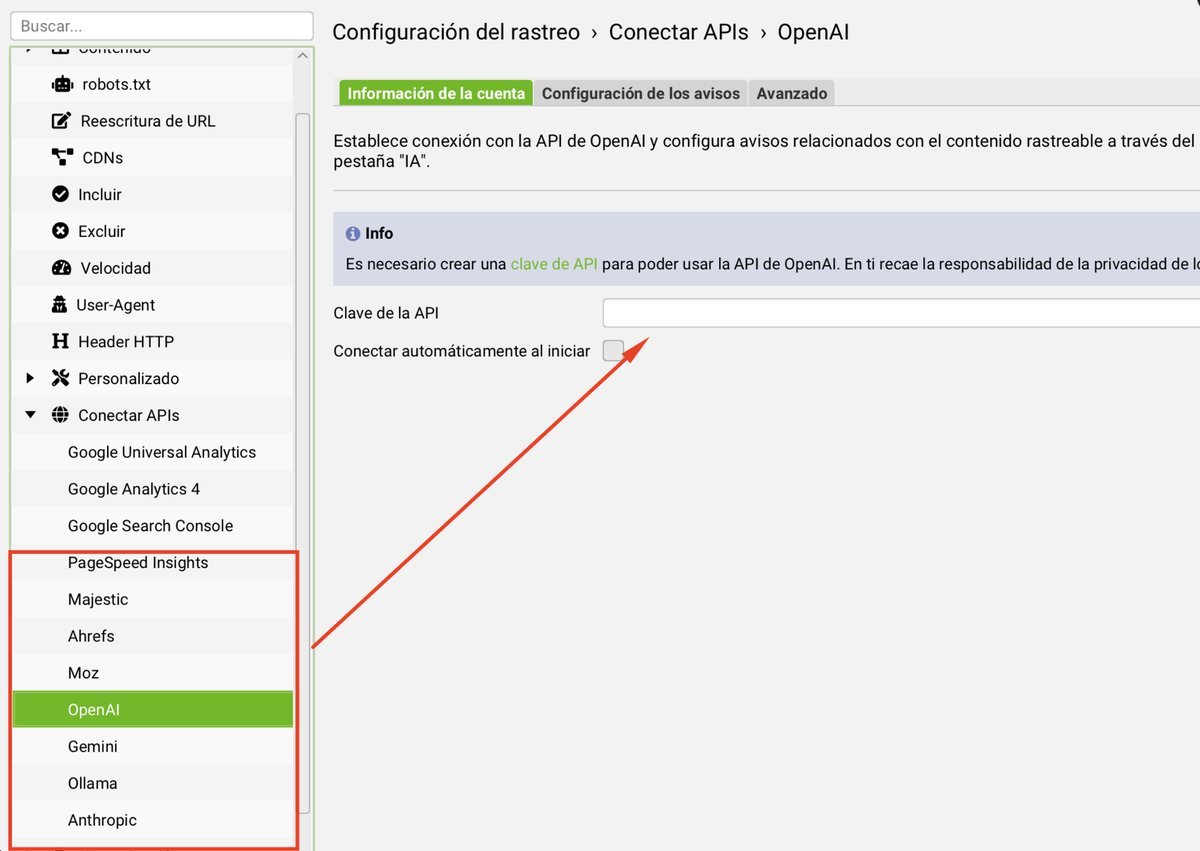

Todas las integraciones se configuran desde Configuración → Conectar APIs.

Conectar Google Search Console

La integración con GSC es, para mí, la más valiosa. Te agrega columnas con datos reales de rendimiento orgánico para cada URL rastreada.

Paso a paso:

- Ve a Configuración → Conectar APIs → Google Search Console

- Haz clic en “Conectar a una nueva cuenta”

- Se abrirá el navegador para que autorices tu cuenta de Google

- Selecciona la propiedad (dominio) que corresponde al sitio que vas a rastrear

- Configura el rango de fechas (recomiendo últimos 3 meses para datos estables)

- Marca las dimensiones que quieres importar: Impresiones, Clics, CTR, Posición media

- Haz clic en Aceptar y lanza el rastreo

¿Qué obtienes? Columnas nuevas en la pestaña Internos con los clics, impresiones, CTR y posición media de cada URL. Esto te permite:

- Detectar páginas con muchas impresiones pero bajo CTR → Mejorar title y meta description (aprende a generarlos en bulk con Screaming Frog)

- Encontrar páginas con posición 5-15 → Candidatas a optimización on-page para subir al top 3

- Identificar páginas con 0 impresiones → Posibles problemas de indexación o canibalización

Conectar Google Analytics 4

La integración con GA4 agrega datos de comportamiento del usuario a cada URL.

Paso a paso:

- Ve a Configuración → Conectar APIs → Google Analytics 4

- Conecta tu cuenta de Google (mismo proceso que GSC)

- Selecciona la propiedad de GA4 correspondiente

- Elige las métricas: Sesiones, Usuarios, Tasa de rebote, Duración media, Conversiones

- Configura el rango de fechas (últimos 3 meses recomendado)

- Acepta y rastrear

Caso de uso real: Cruzo los datos de GA4 con los códigos de respuesta. Si una URL con 500 sesiones/mes devuelve un 404, es una emergencia. Si una URL con 0 sesiones tiene contenido thin, es candidata a eliminar o fusionar con otra página más fuerte.

Conectar APIs de Inteligencia Artificial (nuevo)

Esta es una de las funciones más recientes y potentes de Screaming Frog. Permite conectar modelos de IA como OpenAI (ChatGPT), Google Gemini o Anthropic Claude para analizar el contenido de cada página de forma automática durante el rastreo.

Paso a paso:

- Ve a Configuración → Conectar APIs → IA

- Selecciona el proveedor: OpenAI, Google Gemini o Anthropic Claude

- Ingresa tu API Key del proveedor elegido

- Selecciona el modelo (ej: GPT-4o, Gemini 1.5, Claude Sonnet)

- Define tus prompts personalizados — esto es la clave

- Configura cuántas URLs quieres analizar (cuidado con los costes de API)

¿Para qué sirve? Puedes hacer que la IA analice cada página y te devuelva datos como:

- Clasificación de contenido: “Es esta página informativa, transaccional o navegacional?”

- Evaluación de calidad: “¿El contenido es thin, duplicado o aporta valor?”

- Sugerencias de mejora: “Sugiere un title tag y meta description optimizados para esta página”

- Extracción semántica: “¿Cuáles son los temas principales de esta página?”

- Detección de contenido IA: “¿Este contenido parece generado por IA?”

Pro tip: Usa prompts específicos. En lugar de “analiza esta página”, usa algo como: “Clasifica la intención de búsqueda de esta URL (informativa/transaccional/navegacional). Evalúa si el contenido responde completamente a esa intención. Responde en formato: Intención: X | Completitud: Alta/Media/Baja | Mejora sugerida: Y”

Coste: Cada llamada a la API tiene un coste según el proveedor y modelo. Para un sitio de 200 páginas con GPT-4o, el coste es de aproximadamente $2-5 USD. Un precio insignificante para el valor de análisis que obtienes a escala.

Conectar PageSpeed Insights

Con la API de PageSpeed Insights obtienes métricas de Core Web Vitals para cada URL:

- Ve a Configuración → Conectar APIs → PageSpeed Insights

- Ingresa tu API Key de Google (la obtienes gratis desde Google Cloud Console)

- Selecciona Móvil y/o Escritorio

- Elige las métricas: LCP, FID/INP, CLS, FCP, TTFB, Speed Index

Atención: Esta API es lenta (1-3 segundos por URL). Para sitios de más de 100 páginas, actívala solo para las URLs más importantes o usa el modo “Muestreo” para analizar un porcentaje del total.

Errores comunes al usar Screaming Frog (y cómo evitarlos)

✗ Error: Rastrear sin configurar primero

La configuración por defecto no siempre es óptima. Un sitio con JavaScript necesita renderizado activo. Un servidor débil necesita velocidad reducida. Tómate 2 minutos para configurar antes de lanzar.

✗ Error: No filtrar los resultados

Un sitio de 10.000 URLs tiene miles de filas. Si no filtras por tipo de contenido (HTML), código de respuesta o indexabilidad, te vas a perder en un mar de datos sin acción clara.

✗ Error: Ignorar las URLs con parámetros

URLs como /producto?color=rojo&size=xl pueden multiplicar tu crawl por 10. Revisa en Configuración → Incluir/Excluir si necesitas rastrear parámetros o no.

✗ Error: No guardar el rastreo

Screaming Frog permite guardar el rastreo en Archivo → Guardar. Si cierras sin guardar, pierdes todo y tendrás que rastrear de nuevo. Guarda siempre.

Screaming Frog gratis vs. de pago: ¿vale la pena la licencia?

Versión Gratuita

Para proyectos pequeños

- Hasta 500 URLs por rastreo

- Análisis de títulos, meta, H1, H2

- Códigos de respuesta

- Detección de redirecciones

Extracción personalizadaIntegración GA/GSCRastreo programadoRenderizado JavaScript

Licencia de Pago

£259/año — Para profesionales SEO

- URLs ilimitadas

- Todo lo de la versión gratuita

- ✓ Extracción personalizada (CSS/XPath)

- ✓ Integración Google Analytics + GSC

- ✓ Rastreo programado automático

- ✓ Renderizado JavaScript

- ✓ Comparación de rastreos

- ✓ Guardar y cargar rastreos

Mi opinión: Si eres freelancer o trabajas en una agencia SEO, la licencia se paga sola con un solo proyecto. La extracción personalizada y la integración con GSC son funciones que ahorran horas de trabajo manual cada semana. Si apenas estás empezando o solo necesitas auditar tu propio sitio pequeño, la versión gratuita es más que suficiente para comenzar.

Preguntas frecuentes sobre Screaming Frog

¿Screaming Frog es gratis?

Sí, tiene una versión gratuita que permite rastrear hasta 500 URLs con funcionalidades básicas. Para sitios más grandes o funciones avanzadas como extracción personalizada, integración con APIs de Google y rastreo programado, necesitas la licencia de pago (£259/año).

¿Cuántas URLs puede rastrear Screaming Frog?

La versión gratuita tiene un límite de 500 URLs. La versión de pago no tiene límite técnico: puede rastrear cientos de miles de URLs. El factor limitante será la memoria RAM de tu computador. Para sitios de más de 100.000 URLs, necesitarás al menos 8GB de RAM dedicados a la herramienta.

¿Screaming Frog afecta el rendimiento de mi sitio web?

Puede hacerlo si configuras demasiados hilos de rastreo simultáneos. Para evitar problemas, ajusta la velocidad en Configuración → Velocidad. Con 2-5 hilos el impacto es mínimo en la mayoría de servidores. Nunca uses más de 10 hilos en un servidor compartido.

¿Cómo rastreo un sitio con JavaScript (React, Angular, Vue)?

Ve a Configuración → Spider → Rendering y selecciona “JavaScript”. Esto hará que Screaming Frog renderice cada página como un navegador real antes de analizarla. El rastreo será más lento pero los datos serán mucho más precisos para sitios que dependen de JavaScript para generar contenido.

¿Cómo exporto los datos de Screaming Frog?

Puedes exportar cualquier vista a Excel o CSV desde el menú Exportación en bloque. También puedes hacer clic derecho en cualquier pestaña y seleccionar “Exportar”. Para exportar todo el rastreo completo, ve a Exportación en bloque → Todo. Los datos exportados se abren directamente en Excel o Google Sheets.

¿Puedo usar Screaming Frog para analizar la competencia?

Sí, puedes rastrear cualquier dominio público. Simplemente ingresa la URL del competidor y analiza su estructura, títulos, encabezados, enlaces internos y arquitectura. Es una forma excelente de entender cómo organizan su contenido y encontrar oportunidades que tú puedas aprovechar.

¿Necesitas ayuda con tu auditoría SEO?

Si prefieres que un profesional analice tu sitio con Screaming Frog y te entregue un plan de acción priorizado, solicita una auditoría SEO profesional.

Solicitar auditoría SEO